De la physique des signaux aux systèmes d'IA agentiques — bout en bout.

Deux piliers complémentaires — traitement du signal classique et IA moderne — appliqués selon les exigences du problème.

Fondé sur une formation en physique (PhD, Université Laval), ce domaine couvre la modélisation mathématique, l'analyse spectrale et l'extraction de signaux dans des environnements bruités. La bonne approche est choisie selon le problème, et non l'inverse.

Techniques

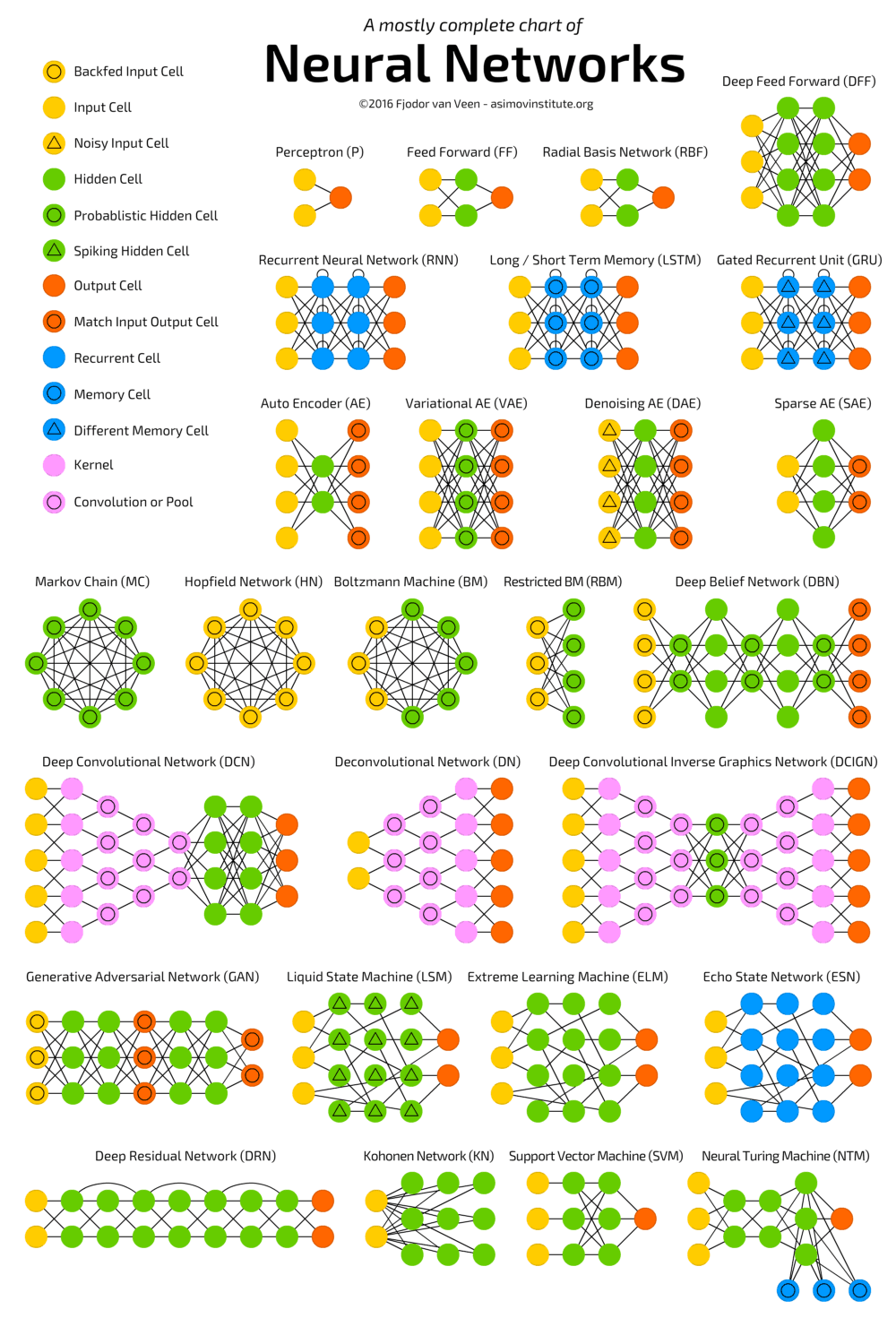

Du deep learning classique (CNN, RNN) aux architectures transformeurs, LLMs, fine-tuning, RAG et workflows agentiques — Paul couvre l'IA de 2026 dans son ensemble. La puissance réelle de l'IA réside dans la qualité des données et la rigueur du problème posé.

Techniques

Les LLMs ont ouvert une classe entièrement nouvelle d'algorithmes — construits avec des mots et des documents, pas seulement des chiffres.

Les systèmes experts traditionnels sont une série semi-infinie de règles if/else, codées laborieusement une décision à la fois. Ça fonctionne — jusqu'à ce que la réalité dépasse les scénarios que le développeur avait anticipés. Le résultat : une logique fragile qui sur-apprend les données disponibles au moment du codage et casse sur toute nouveauté.

if (condition_1) → rule_A else if (condition_2) → rule_B else if (condition_3) → rule_C ... × 1000

Les LLMs, le RAG et les embeddings changent la donne. Au lieu d'encoder chaque décision comme une règle, on peut construire des algorithmes qui raisonnent sur des documents, des manuels et des connaissances de domaine directement. Le fossé entre les chiffres bruts et la compréhension humaine — celui que les systèmes experts tentaient de combler avec des milliers de règles — est maintenant franchi par des modèles qui comprennent le langage nativement.

La vraie percée : combiner le traitement du signal et l'analyse numérique avec le raisonnement propulsé par les LLMs. Les données de capteurs passent par des algorithmes classiques pour l'extraction et le filtrage, puis transitent vers une couche LLM qui interprète les résultats à l'aide de documents de domaine et de connaissances contextuelles. Un seul pipeline — des chiffres en entrée, des décisions en sortie — sans la chaîne fragile de if/else entre les deux.

Modèles locaux, RAG privé, pipelines d'embeddings — conçus pour les clients où la souveraineté des données, la conformité ou le contrôle des coûts excluent les APIs publiques.

Les APIs LLM publiques sont puissantes, mais pas adaptées à tous les problèmes. Quand vos données ne peuvent pas sortir de vos murs — pour des raisons réglementaires, de PI ou stratégiques — on déploie toute la stack sur votre matériel. Mêmes capacités, zéro fuite, pas de facturation au token.

Ollama, llama.cpp, vLLM sur vos serveurs ou équipements de périphérie. Modèles open-weight quantifiés (Llama, Mistral, Qwen) dimensionnés à votre budget GPU. Fine-tuning sur votre domaine quand la précision compte.

Vos manuels, spécifications, tickets et historiques indexés dans un vector store privé. Le LLM répond aux questions en s'appuyant sur votre corpus — pas sur Internet. Pas de fuite, pas de politiques hallucinées.

Ingestion bout en bout : chunking, embeddings, indexation (pgvector, Qdrant, Weaviate). Recherche sémantique, clustering, déduplication — le côté numérique de la récupération de connaissances, conçu pour passer à l'échelle.

Déploiements complètement déconnectés pour la défense, la santé ou la fabrication réglementée. Journaux d'audit, contrôles d'accès par rôle, inférence reproductible. La capacité IA sans le casse-tête de la conformité.

Pourquoi sur site

Souveraineté des données — rien ne sort de votre infrastructure

Coût prévisible — matériel fixe plutôt que facturation au token

Prêt pour la conformité — HIPAA, GDPR, ITAR, contextes de défense

Un processus rigoureux en quatre étapes — du problème à la production — sans raccourcis.

01

Comprendre le problème avant tout outil. Décomposition en exigences, contraintes et critères de succès.

02

Choisir ou construire le modèle mathématique ou l'architecture IA adapté au problème.

03

Valider les hypothèses avec un POC — livré vite, itéré tôt, avant tout investissement majeur.

04

Optimisation, intégration, tests de robustesse. De l'algorithme au système livrable.

Traçabilité des données, qualité des labels, augmentation et génération synthétique quand la donnée est rare — Paul intègre la gestion des données dans chaque engagement IA, pas en afterthought.

Réponse sous 24 heures.

Paul développe les algorithmes de ses clients avec une infrastructure d'agents IA spécialisés — non pas comme gadget, mais comme avantage concurrentiel mesurable.

Paul développe les algorithmes de ses clients avec une pratique de développement assistée par des agents IA spécialisés — non pas comme gadget, mais comme infrastructure d'ingénierie. Le résultat : une vitesse de prototypage et une couverture de test impossibles à atteindre en développement traditionnel.

70+

agents spécialisés

20+

workflows d'orchestration

Jours

pas des semaines

Des agents génèrent les implémentations candidates à partir des spécifications mathématiques. Un POC fonctionnel en jours, pas en semaines.

Des agents spécialisés génèrent des suites de tests couvrant les cas limites, la stabilité numérique et les entrées dégénérées — avant même la livraison.

Un agent de revue évalue chaque implémentation contre les bonnes pratiques algorithmiques : vectorisation, complexité, bibliothèques numériques appropriées.

La scaffolding (annotations de type, docstrings, logging, configuration) est gérée par des agents. Paul se concentre sur la mathématique et la physique qui ne peuvent pas être déléguées.

Plusieurs agents opèrent simultanément — tests, documentation, benchmarking, revue — pendant que Paul travaille sur le cœur numérique. Impossible avec un développeur linéaire seul.

L'infrastructure agentique produit une qualité de code d'équipe complète à un coût de consultant indépendant. Correctement, rapidement, sans sacrifier la rigueur.

Le raisonnement mathématique, la modélisation physique et les décisions d'architecture ne se délèguent pas à des agents IA. C'est la combinaison de cette expertise de domaine irremplaçable avec les outils agentiques modernes qui produit des algorithmes justes, rapides et livrables.

Des exemples concrets tirés de projets réels — chaque exemple répond à une problématique technique précise.

Extraction de signaux faibles sur données de capteurs bruitées — transformées de Fourier, détection par amplificateur lock-in, décomposition PCA pour identifier les composantes physiques pertinentes.

Détection d'objets, de défauts ou de patterns dans des flux d'images industriels ou médicaux, à l'aide d'architectures CNN optimisées pour des contraintes de latence et de données limitées.

Algorithmes de traitement spectral (FTIR, radar) pour la détection et la quantification de contaminants atmosphériques — déployés en environnement industriel (ex. ABB).

Intégration d'un LLM avec RAG pour contextualiser des recommandations à partir d'une base de données utilisateur — implémenté dans masemaine.ca. Inclut fine-tuning léger et pipeline d'inférence.

Conception de systèmes multi-agents capables de décomposer des tâches, d'appeler des outils externes et de boucler sur les résultats — applicable à l'automatisation industrielle et aux plateformes SaaS.

Extraction d'événements physiques à partir de signaux de speckles laser. Des contraintes de monotonicité rejettent les creux transitoires et les artefacts ; un débruitage par CNN fusionne plusieurs canaux de caractéristiques simultanément — remplaçant les cascades de seuils fragiles par un modèle qui apprend la structure complète du bruit.

Trois différenciateurs spécifiques — pas une biographie générale.

Un PhD en physique (nanophotonique, Université Laval) n'est pas qu'un titre — c'est une formation à modéliser des phénomènes complexes où les approximations ont des conséquences mesurables. Chaque algorithme repose sur une compréhension physique du problème, pas seulement sur un appel de librairie.

15+ ans d'ingénierie appliquée dans les secteurs photonique, médical, industriel et énergie. Les algorithmes ne restent pas dans un notebook — ils sont intégrés, testés sous contraintes réelles, certifiés si requis, et déployés. Ce n'est pas du consulting qui s'arrête au prototype.

Paul combine une expertise de domaine irremplaçable (physique, mathématiques appliquées) avec une infrastructure de développement agentique de 70+ agents spécialisés. Le résultat : la rigueur d'un physicien avec la vitesse d'une équipe complète. Ni l'un ni l'autre seul n'y arrive.

Décrivez votre défi — Paul revient sous 24 heures avec une première analyse.